О чем речь? Технология Big Data – работа с массивами больших данных. Она заключается в их извлечении из источников, сборке, обработке, хранении и анализе для получения полезной информации. Полученные результаты используют в прогнозировании продаж, оптимизации производства или рекламных кампаний, оценке кредитных историй и много где еще.

О чем речь? Технология Big Data – работа с массивами больших данных. Она заключается в их извлечении из источников, сборке, обработке, хранении и анализе для получения полезной информации. Полученные результаты используют в прогнозировании продаж, оптимизации производства или рекламных кампаний, оценке кредитных историй и много где еще.

Что учесть? Для работы с Big Data требуется недюжинный опыт, который заключается в знании языков программирования, датасетов разного содержания, математических методов, логических приёмов, инструментов для сортировки и визуализации данных, основ машинного обучения. Всему этому можно научиться, но куда проще нанять Chief Data Officer или Data Scientist.

Что учесть? Для работы с Big Data требуется недюжинный опыт, который заключается в знании языков программирования, датасетов разного содержания, математических методов, логических приёмов, инструментов для сортировки и визуализации данных, основ машинного обучения. Всему этому можно научиться, но куда проще нанять Chief Data Officer или Data Scientist.

Из этого материла вы узнаете:

- Что собой представляет технология Big Data

- Краткая история Big Data

- Где применяется технология Big Data

- Принципы работы с Big Data

- Параметры Big Data

- Кто работает с Big Data

- 3 этапа работы с Big Data

- Источники Big Data

- Технологии обработки Big Data

- Инструменты обработки Big Data

- Методы анализа Big Data

- Преимущества и недостатки технологии Big Data

- Использование Big Data в России и мире

- Часто задаваемые вопросы о технологии Big Data

-

Чек-лист: Как добиваться своих целей в переговорах с клиентамиСкачать бесплатно

Чек-лист: Как добиваться своих целей в переговорах с клиентамиСкачать бесплатно

Что собой представляет технология Big Data

Что такое технология больших данных – Big Data? Это структурированные, частично структурированные или неструктурированные объемы данных. Речь идёт о специфическом подходе к информации, объём которой превышает возможности традиционных методов обработки и анализа.

Вот различные примеры больших данных:

-

информация о действиях пользователей в соцсетях за месяц: комментарии, активности, лайки;

-

база данных населения в структуре распознавания лиц;

-

системные журналы серверов, накапливающие огромные объёмы операционной информации;

-

медицинская база данных, включающая документы с историей лабораторных анализов за многолетний период в централизованном комплексе медицинского учёта;

-

анализ гигантского объёма запросов поисковых систем пользователей.

Источник: shutterstock.com

Данные, которые не относятся к категории больших:

-

ежемесячная статистика продаж розничного магазина;

-

финансовые операции одного банковского клиента за календарный год, включая все поступления и списания средств;

-

документы в системе управления взаимоотношениями с клиентами (CRM) юридической фирмы, содержащие всю необходимую контактную и деловую информацию.

Технологии Big Data получили широкое распространение как на международном уровне, так и в российской практике. Их применение охватывает множество ключевых секторов: от медицинской сферы и финансового сектора до сферы телекоммуникаций, розничной торговли и электронной коммерции.

В частности, банковский сегмент использует аналитику больших данных для обеспечения безопасности транзакций и защиты от мошенничества. В области здравоохранения технологии Big Data способствуют оптимизации мониторинга состояния пациентов и анализу медицинских показателей для своевременного выявления потенциальных рисков.

Краткая история Big Data

Концепция больших данных впервые была сформулирована в 2008 году благодаря Клиффорду Линчу. В специальном выпуске научного журнала Nature он ввел термин Big Data для описания стремительного роста информационных потоков, определив его как массивы разнородных данных объемом более 150 гигабайт в сутки.

Согласно аналитическим данным, объем информации в мире в 2005 году составлял 4-5 эксабайт. Это эквивалентно 4-5 миллиардам гигабайт. К 2010 году этот показатель достиг 0,19 зеттабайт, что в 1024 раза превышало объем эксабайта. В 2012 году наблюдался дальнейший рост до 1,8 зеттабайт, а к 2015 году показатель увеличился до 7 зеттабайт.

Читайте также!

Практическое применение технологий больших данных до 2011 года ограничивалось научной сферой. Но стремительное увеличение информационных потоков создало потребность в решении проблемы работы с неструктурированными и разнородными объемами к началу 2012 года. Этот тренд четко прослеживается в данных Google Trends, демонстрирующих рост интереса к Big Data.

Крупнейшие компании цифровой индустрии, такие как Microsoft, IBM, Oracle и EMC, активно включились в развитие процессов в больших данных. С 2014 года технологии Big Data вошли в образовательный инструментарий университетов и начали использоваться в различных прикладных науках, включая инженерию, физику и социологию.

Где применяется технология Big Data

-

Розничная торговля. Изучение данных о потребительском спросе, конкурентной среде и сезонных колебаниях даёт возможность коммерческим компаниям гибко корректировать ценовую политику для достижения максимальной прибыльности. Супермаркеты, например, используют технологии обработки Big Data для оптимизации размещения товаров на полках и формирования ассортимента, помогая увеличить сбыт, повысить удовлетворенность клиентов.

-

Медицинская сфера. Big Data – это мощный инструмент для раннего обнаружения и предотвращения эпидемий. Благодаря обработке информации из различных источников специалисты могут своевременно выявлять первые признаки распространения заболеваний и оперативно реагировать на потенциальные угрозы.

-

Финансовая сфера. Анализ больших данных стал помощником для принятия решений о размещении капитала. Изучая гигантские объемы информации (кредитные истории клиентов, состояние рынка), финансовые организации могут точно оценивать потенциальные риски и формировать оптимальную инвестиционную стратегию.

-

Производственная отрасль. Благодаря технологии Big Data компании получают возможность существенно повышать эффективность производственных процессов. Анализ информации с производственных датчиков помогает находить проблемные участки и оптимизировать рабочие настройки.

-

Логистика. Использование технологии Big Data помогает строить наиболее эффективные маршруты, учитывая трафик, погодные условия и состояние дорог, что существенно экономит время в пути.

Практическое применение анализа больших данных:

-

Классификация потребителей. Ключевой и наиболее результативный способ использования Big Data в рекламе заключается в разделении целевой аудитории (ЦА) на сегменты по возрасту, интересам, покупательским привычкам и прочим характеристикам, что помогает делать персонализированные предложения в самый подходящий момент.

-

Повышение эффективности рекламы. Big Data позволяет оценивать результативность маркетинговых кампаний и своевременно вносить необходимые изменения для достижения лучших показателей.

-

Мониторинг общественного мнения. Компании отслеживают отзывы и социальные медиапубликации, чтобы оценить отношение потребителей к своим товарам и услугам.

-

Планирование на основе данных. Цифровая технология Big Data позволяет компаниям точно прогнозировать востребованность товаров и услуг с учетом различных рыночных факторов.

-

Оптимизация стоимости. Big Data дает возможность организациям адаптировать цены товаров и услуг в реальном времени, учитывая рыночный спрос и конкурентную среду.

-

Повышение качества обслуживания. Анализ больших данных даёт организациям возможность поднять качество сервиса на новый уровень и оперативно устранять проблемы потребителей.

Принципы работы с Big Data

В отличие от стандартных баз данных и электронных таблиц, технология Big Data базируется на трёх фундаментальных принципах обработки информации:

-

Линейное масштабирование. Это ключевой механизм адаптации компьютерной системы к растущим объемам информации. При существенном увеличении базы данных должна быть возможность добавить соответствующие мощности для сохранения производительности.

-

Стабильность функционирования. Для работы с большими данными используются сложные вычислительные системы. В силу их сложности и масштабности нельзя исключить появление локальных сбоев. Поэтому критически важно сохранение работоспособности системы при отказе отдельных компонентов.

-

Локальное хранение данных. Распределенные системы (где материалы разбиваются на сегменты) сегодня являются наиболее распространенным решением. Для достижения высокой эффективности важно, чтобы каждый компонент обрабатывал только собственную часть информации, не требуя взаимодействия с остальными модулями. Такой режим деятельности обеспечивается соблюдением принципа локальности данных.

Источник: shutterstock.com

Наряду с представленными, имеются и другие методы обработки значительных объемов информации, отличающиеся подходами к анализу данных. Однако три упомянутых принципа являются базовыми и применяются практически повсеместно.

Параметры Big Data

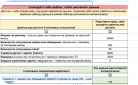

В аналитике больших данных выделяют шесть определяющих параметров, известных как 6 «V» Big Data:

-

Volume – объём данных, который начинается от 150 гигабайт в сутки.

-

Velocity – скорость обработки. Данные в Big Data меняются ежемоментно, требуя мощных вычислительных систем для их «шлифовки». Это наглядно демонстрирует система онлайн-аналитики трафика в реальном времени. Там каждая секунда приносит новые данные о движении транспортных потоков.

-

Variety – разнообразие. Характеризуется вариативностью форматов информации: от текстовых документов до мультимедиаконтента, объединяя разные ее типы. В отличие от традиционных данных, которые обычно структурно однородны (например, список работников в Excel).

-

Veracity – достоверность. Характеристика Big Data, подтверждающая надёжность источников информации и точность методов её обработки. Это даёт возможность использовать данные для принятия важных стратегических решений на международном и корпоративном уровнях.

-

Variability – изменчивость. Свойство больших данных, проявляющееся в их онлайн-обновлении и нестабильности потока информации. При анализе важно учитывать множество переменных: скорость передачи, источники данных, пользовательскую активность и сезонные колебания. Так, при анализе данных о транспортных потоках необходимо учитывать время суток, дорожные работы и праздничные дни.

-

Value – ценность. Это способность данных генерировать ценность через анализ. Несмотря на кажущуюся бесполезность исходных показателей, их тщательное изучение позволяет находить решения сложных задач, например планирование маркетинговой стратегии на основе поведения пользователей в социальных сетях.

Читайте также!

Big Data бывают:

-

Структурированные – данные с предварительной разметкой по определённым характеристикам. Как, например, информация о товарах в интернет-магазине: название, категория, цена, количество на складе и рейтинг.

-

Частично структурированные – информация с элементами организации, но без чёткой структуры. Пример: собрание документов о производственных показателях завода за квартал.

-

Неструктурированные – характеризуются отсутствием явной структуры. Например, все фотографии, аудиозаписи и личные сообщения в VK.

Особенность цифровых технологий Big Data заключается в их модульной структуре, благодаря которой обработка и анализ осуществляются с помощью множества отдельных сервисов.

Загрузка традиционной информации происходит быстро и без сложностей, поскольку она поступает из одного источника. Большие данные, напротив, создают дополнительную нагрузку из-за множества корней и значительного объёма. Специальные сервисы помогают ускорить обработку и структурировать информацию.

Кто работает с Big Data

В сфере деятельности с большими данными существует множество профессий:

-

руководитель по данным Chief Data Officer;

-

аналитик Big Data;

-

инженер по обработке данных;

-

DevOps для Big Data;

-

специалист по визуализации данных и другие.

Для успешной работы с Big Data необходимы специалисты разных профилей. Data storytelling выступает ярким примером такого направления, где профессионалы умеют превращать сложные массивы данных в понятные истории.

Увеличим продажи вашего бизнеса с помощью комплексного продвижения сайта. Наша команда экспертов разработает для вас индивидуальную стратегию, которая позволит в разы увеличить трафик, количество заявок и лидов, снизить стоимость привлечения клиентов и создать стабильный поток новых покупателей.

При этом используя различные визуальные инструменты: от простых графиков до сложных видеопрезентаций. Data storytelling успешно работает в двух направлениях: для внутренней мотивации персонала к улучшению продукта и для внешней презентации его преимуществ потенциальным клиентам.

3 этапа работы с Big Data

В современном мире компании активно используют большие данные как источник ценной информации. Это позволяет им находить новые перспективы развития и выстраивать эффективные способы ведения бизнеса. Весь процесс работы с большими данными можно разделить на три последовательных стадии.

1 этап. Интеграция

На этом этапе организация осуществляет технологическое обновление своей базы, направленное на оптимизацию процессов сбора и обработки значительных объемов данных.

2 этап. Управление

Первостепенной задачей является организация хранения данных. Ее необходимо решить еще до начала их обработки. При выборе подходящего варианта ключевую роль играют особенности формата данных. И применяемые технологии их обработки, наряду с другими важными параметрами.

3 этап. Анализ

Практическая значимость Big Data реализуется в ходе финального этапа работы с ними – интеллектуального исследования. С помощью машинного обучения, генетических алгоритмов и систем ассоциативного анализа из всего объема информации выделяются только критически важные для бизнеса данные.

Источники Big Data

Применение технологии Big Data даёт возможность учесть вcе критические факторы при принятии стратегических решений. С её помощью создаются модели, позволяющие тестировать бизнес-решения и инновационные разработки.

из разных ниш с ростом

от 89% до 1732%

Основные источники больших данных:

-

умные технологии: интернет вещей (IoT) и устройства;

-

медиапространство: соцсети, блоги, новостные порталы;

-

корпоративные материалы: финансовые операции, клиентские базы, заказы;

-

показания приборов: метеорологические станции, экологические датчики, спутниковые данные;

-

государственная статистика: миграционные потоки, статистика населения, демографические показатели;

-

здравоохранение: лабораторные исследования, диагнозы, проверочные изображения.

Начиная с 2007 года американские спецслужбы (ФБР и ЦРУ) получили доступ к программе PRISM. Это передовой инструмент слежения, позволяющий собирать обширную информацию о пользователях. В зону охвата программы входят социальные сети, сервисы ведущих IT-компаний (Microsoft, Google, Apple, Yahoo), записи телефонных разговоров.

Источник: shutterstock.com

Современные вычислительные технологии позволяют мгновенно работать с информацией, которая размещается на серверах в специализированных центрах обработки больших данных. Для этого используются не только традиционные физические серверы, но и облачные хранилища типа data lake (для хранения неструктурированных материалов с единого источника).

Дополнительно применяется фреймворк Hadoop, включающий утилиты для распределенных вычислений. Работу с данными поддерживают передовые технологии интеграции, управления и подготовки информации к аналитике.

Извлечение данных осуществляется посредством двух различных технологий:

-

Метод полного извлечения информации без мониторинга обновлений. Отличается технической простотой, но требует больше системных мощностей.

-

Инкрементное извлечение. Последовательное отделение данных с отслеживанием изменений относительно предыдущего успешного копирования. Реализуется через журналы изменений или временные метки. Технология CDC обеспечивает сохранение состояний данных, делая процесс сложнее, но эффективнее с точки зрения ресурсов.

Технологии обработки Big Data

Существует три основных технологии для хранения и обработки данных:

-

Реляционная система управления базами данных СУБД. Это платформа, где они размещаются и обрабатываются в единой базе на одном сервере согласно заданной структуре. Управление данными происходит посредством SQL. Данная модель является наиболее распространенной, а лидерами рынка выступают Oracle, Microsoft и IBM.

-

Горизонтально масштабируемая база данных. Это платформа, где информация размещается на множестве серверов без жесткой структуры. Система позволяет наращивать мощности путем добавления новых серверов. Анализ данных выполняется параллельно на всех узлах с последующей консолидацией результатов. Такой подход реализован в Hadoop с использованием технологии MapReduce.

-

In-memory-системы. Это платформа для оперативной подготовки и анализа материала различной структуры. Они обеспечивают мгновенную обработку и строго организованных, и частично структурированных данных. И объединяют возможности транзакционной и аналитической деятельности. Такие системы специализируются на работе с актуальными данными, примером является SAP HANA.

Читайте также!

Инструменты обработки Big Data

Среди них можно отметить следующие:

-

Apache Hadoop. Это один из самых востребованных инструментов для работы с большими данными, состоящий из файловой системы HDFS и компонента обработки MapReduce.

-

Apache Spark. Высокопроизводительное решение для параллельной обработки данных с поддержкой различных языков программирования: Java, Scala, Python и R. Его способность вести деятельность в памяти и в режиме реального времени делает его более производительным по сравнению с Hadoop MapReduce.

-

NoSQL-базы данных. Это масштабируемые решения для работы с неструктурированными материалами, что делает их незаменимыми в сфере приложений Big Data.

-

Системы потоковой обработки данных. Технологии, такие как Apache Kafka, Apache Storm, Apache Flink, обеспечивают надежную и эффективную деятельность в реальном времени.

-

Искусственный интеллект и машинное обучение. Помогают в обработке данных, обнаружении значимых закономерностей, прогнозировании тенденций и создании автоматизированных систем принятия решений.

-

Кластерные системы управления данными. Предназначены для обработки Big Data с высокой скоростью доступа и возможностью масштабирования.

-

Средства визуализации данных. Инструменты Tableau, Power BI и D3.js предоставляют возможности для создания информативных графиков и диаграмм, способствуя лучшему пониманию анализируемой информации.

Методы анализа Big Data

Среди главных способов обработки больших данных выделяют:

Источник: shutterstock.com

-

Методы глубокого анализа и систематизации данных, изначально разработанные для работы с небольшими наборами структурированной информации, получили новое развитие благодаря усовершенствованным цифровым алгоритмам.

-

Технология краудсорсинга. Она позволяет собирать и анализировать огромные объемы данных (миллиарды байт) из множества источников, ограничиваясь лишь техническими возможностями системы.

-

Технология сравнительного анализа (сплит-тестирование). Оно заключается в парном соотнесении отобранных элементов в их начальном и измененном состоянии (до/после). Благодаря серии А/В-тестов можно определить наиболее значимые факторы воздействия на элементы. А многократное повторение анализа обеспечивает получение достоверных результатов.

-

Система прогнозирования: начальное установление определенных параметров, затем – отслеживание динамики объекта с опорой на анализ обширных данных.

-

Мониторинг сетевой активности осуществляется через применение Big Data для анализа взаимодействий между пользователями, их объединениями/сообществами, способствуя формированию целевых групп по интересам, географии, возрасту и другим показателям.

Преимущества и недостатки технологии Big Data

Это важнейший стимул развития мировой экономики. Технологии Big Data помогают:

-

Осуществлять анализ обширных баз данных. В частности, многопользовательских – социальной платформы VK. Здесь каждый профиль включает сотни элементов контента: сообщений, изображений, музыкальных треков и видеозаписей.

-

Создавать высокоточные прогнозы и принимать обоснованные решения. Так, при разработке PR-стратегии можно использовать данные Яндекс.Метрика о поведении миллионов посетителей, включая их предпочтения, настройки, историю. Это – возможность таргетировать рекламу фитнес-центра исключительно на аудиторию, интересующуюся здоровым образом жизни и спортом.

-

Обеспечивать моментальную защиту от несанкционированных операций. Анализируя массив данных о транзакциях пользователей в реальном времени, финансовые учреждения способны мгновенно обнаруживать признаки мошенничества и предотвращать незаконные действия.

-

Создавать перспективные планы развития. На основе многолетней статистики финансовых показателей компания сможет эффективно прогнозировать рост, оптимизировать штат и формировать рациональный ассортимент.

-

Усовершенствовать клиентский сервис. Например, анализ отзывов показал, что многие пользователи мобильного приложения жалуются на медленную загрузку страниц в утренние часы. Причина – высокая нагрузка на серверы. Решение – усиление их мощности в это время.

из разных ниш с ростом

от 89% до 1732%

Нельзя не отметить ряд недостатков технологии Big Data:

-

Проблемы с увеличением нагрузки. Изначально сервис работает с базой в 10 тысяч человек. Внезапный рост аудитории до миллиона после marketing-кампании создает серьезную нагрузку на систему. Лучшее решение – использовать облачные сервисы с функцией быстрого расширения.

-

Серьезные угрозы безопасности. Работа с Big Data требует повышенного уровня защиты. Ведь утечка информации из банковской системы может привести к финансовым потерям миллионов людей. Для предотвращения подобных ситуаций организации применяют многоуровневую систему контроля: каждому сотруднику предоставляется доступ только к строго определенным разделам базы данных. Информация защищается шифрованием на всех этапах обработки.

-

Высокие финансовые расходы. Обработка больших данных невозможна без серьезных вложений в техническую инфраструктуру и специализированное ПО. Например, для разработки систем распознавания речи требуются колоссальные объемы аудиозаписей, которые есть только у очень крупных корпораций и часто недоступны для свободного пользования. Необходим также целый штат квалифицированных специалистов: от аналитиков данных до BI-разработчиков.

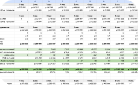

Использование Big Data в России и мире

В отличие от РФ, зарубежье уделяет значительно больше внимания контролю использования больших данных. Это строгая политика двойственного характера. С одной стороны – обеспечивает надежную защиту личных данных пользователей интернет-сервисов, а с другой – существенно ограничивает потенциал развития бизнеса. Так, европейский GDPR (General Data Protection Regulation) накладывает строгие ограничения на сбор персональной информации.

Под действие регламента попадают медицинские данные. Использование такой информации могло бы помочь фармацевтическим компаниям и медицинским сервисам экономить средства на PR-кампании, но закон запрещает сбор и обработку этих данных без специального согласия пациентов.

В США основные владельцы и пользователи Big Data – крупнейшие технологические компании, такие как Apple, Google и Amazon. Но власти ежегодно ужесточают контроль над их монополией. В некоторых штатах, например Калифорнии, пользователи получили право требовать от онлайн-сервисов раскрытия и удаления своих персональных данных.

В сфере больших данных информация классифицируется на два основных типа: персональные данные, подлежащие строгой правовой защите (включая Федеральный закон № 152), и обезличенные. Первые позволяют точно установить персону (ФИО, адрес проживания, телефон). Вторые – без прямых идентификаторов (геолокация без привязки к клиенту, история покупок).

Источник: shutterstock.com

Более 200 законов и правил в Китае обеспечивают защиту персональных данных вплоть до информации, собираемой мобильными приложениями. Это стало причиной ограничения работы большинства зарубежных социальных сетей и международных онлайн-сервисов, хотя государственные органы сохраняют доступ к ним.

Особенность заключается в том, что обезличенные данные из различных источников при их объединении могут раскрыть личную информацию. На основе информации о поездках и заказах можно составить полный портрет человека, включая его адрес, место работы, уровень дохода и предпочтения в покупках. На этом строится бизнес ведущих компаний, работающих с Big Data.

Часто задаваемые вопросы о технологии Big Data

Чем отличаются она и Data Science?

Data Science – это наука о данных, сфера деятельности, область, занимающаяся извлечением ценной информации из любых массивов информации (структурированных и нет). Делает это с помощью математического анализа, статистики и программных инструментов. Data Science направлена на извлечение пользы из данных, а не просто на их обработку.

Какие языки программирования применяются при обработке Big Data?

Scala – основной язык от Apache Spark. Активно применяется в анализе данных. Большинство проектов Apache Software Foundation, включая Spark и Kafka, реализованы именно на нем.

Python – язык с богатым набором библиотек для AI/ML: TensorFlow, PyTorch, SKlearn, а также для анализа данных: Matplotlib, Scipy, Pandas. Интегрируется с Kafka, Spark и Hadoop.

Какие книги помогут разобраться в теме?

Литература по Big Data:

-

Билл Фрэнкс, «Революция в аналитике».

-

Д. Силен, А. Мейсман, М. Али, «Основы Data Science и Big Data».

-

Кэти О'Нил, «Убийственные большие данные».

-

Кеннет Су, Анналин Ын, «Теоретический минимум по Big Data».

-

Кеннет Кукьер, Виктор Майер-Шенбергер, «Большие данные».

С чего начать путь в Big Data?

-

Изучение открытых наборов данных различной тематики, доступных на платформе Хабр, позволит освоить принципы работы с информацией. Хранилища объемом 10 Тб будет достаточно для изучения основ организации Big Data.

-

Для эффективной обработки информации потребуется знание SQL. И также одного из языков программирования: Python, R или Scala. Эти инструменты позволят работать с базами данных и формировать понятные отчеты с визуализацией итогов.

-

Пройдите профессиональное обучение, чтобы сформировать прочную теоретическую базу. Курсы охватывают применение технологий Big Data в научных исследованиях и бизнес-процессах, включая изучение математических моделей, логических алгоритмов, средств обработки и визуализации данных. Программа адаптирована как для технических специалистов, так и для новичков в IT-сфере.

Осваивать Big Data следует с базовых методов обработки информации. Независимо от размера датасета – будь то тысяча или миллион записей – принципы анализа постоянны, меняется лишь инструментарий в зависимости от объема данных. Умение работать с данными: фильтровать, объединять, исследовать и очищать их – ключевой навык для любой деятельности в этой сфере.

Источник изображения на шапке: shutterstock.com

Оставить комментарий

Оставить комментарий