О чем речь? Дубли страниц на сайте возникают при появлении идентичного или схожего контента по разным URL-адресам. Эта проблема негативно влияет на продвижение в поисковиках и пользовательский опыт.

О чем речь? Дубли страниц на сайте возникают при появлении идентичного или схожего контента по разным URL-адресам. Эта проблема негативно влияет на продвижение в поисковиках и пользовательский опыт.

Что делать? Эффективными методами являются настройка канонических тегов, правильная конфигурация ЧПУ и использование 301-редиректов. Также важно контролировать параметры URL и исключать индексацию служебных страниц через robots.txt.

Что делать? Эффективными методами являются настройка канонических тегов, правильная конфигурация ЧПУ и использование 301-редиректов. Также важно контролировать параметры URL и исключать индексацию служебных страниц через robots.txt.

Из этого материала вы узнаете:

- Негативное влияние дублей страниц на сайте

- Явные дубли страниц на сайте

- Неявные дубли страниц на сайте

- Работа с дублями страниц пагинации на сайте

- Способы обнаружить дубли страниц на сайте

- Часто задаваемые вопросы о дублях страниц на сайте

-

Чек-лист: Как добиваться своих целей в переговорах с клиентамиСкачать бесплатно

Чек-лист: Как добиваться своих целей в переговорах с клиентамиСкачать бесплатно

Негативное влияние дублей страниц на сайте

Сайт хуже индексируется поисковыми системами

Данная проблема является серьезной, ведь она запускает цепочку других трудностей. Разберемся с логикой снижения скорости индексирования сайта.

Для начала объясним понятие, которое в SEO называется краулинговым бюджетом. Под ним понимают ограничение по числу страниц ресурса, которые сканируются поисковыми алгоритмами за определенный промежуток времени.

Обратите внимание на слово «ограничение». Это значит, что даже самый продвинутый сайт алгоритмы не будут мониторить регулярно.

Чем больше дублей страниц на вашем сайте, тем меньше возможности у робота-сканера успеть проанализировать ресурс. Скорее всего, важные для поиска разделы будут пропущены во время одного из визитов, а это влияет на попадание в индексацию. Даже наличие на ресурсе страниц-дублей влияет на краулинговый бюджет, уменьшая его. Сама же проблема стремительно растет.

Вместо того, чтобы мешать роботам находить нужные и важные разделы для показа, удаляйте дубли, сообщайте им, на что обратить внимание и проиндексировать. Как только начнете убирать неэффективные страницы, краулинговый бюджет вырастет. Позиции сайта в выдаче пойдут вверх.

Исключение нужных страниц из результатов пользовательского поиска

Иногда дубль занимает место важной страницы, потому что не хватило ресурса в виде краулингового бюджета в процессе анализа алгоритмами. Роботы просто не успевают добраться до основной информации, которую вы хотите продвинуть. Такая рокировка заметно снижает позиции сайта в выдаче.

Борьба дублирующих страниц между собой за место в результатах поиска

Когда на вашем ресурсе сразу несколько дублей, они зачастую просто сменяют друг друга. Это уменьшает рейтинг сайта в поисковой системе. Чем дольше продолжается такая ситуация, тем сложнее будет подняться обратно.

Источник: shutterstock.com

Пользователи начнут заходить на страницы-дубли, поисковики сочтут эту информацию важной. Объяснить роботу, что произошла ошибка, будет тяжело. Лучше привести сайт в порядок с самого начала.

Потеря внешнего ссылочного веса

Если пользователь, зашедший по запросу в поиске на дубль, поделится ссылкой с другими, а затем вы удалите страницу, то новых переходов не будет. Войти в число рекомендуемых сайтов довольно непросто, поэтому важно отслеживать эти клоны перед тем как они попадут в выдачу.

Потеря внутреннего ссылочного веса

Это случается, иногда ошибки при внутренней перелинковке приводят к дублям. Если не отследить процесс и не исправить, то ссылка после удаления клона будет вести на несуществующую страницу. Сначала удаляйте дубли, а затем занимайтесь внутренней перелинковкой.

Блокировка и санкции от поисковых систем

Конечно, не факт, что за дубль вы сразу получите блок от поисковых алгоритмов. Однако если роботы решат, что в деле имелся умысел, а контент на страничке низкого качества, то сайт могут отправить в черный список и убрать из поиска целиком.

Читайте также!

«Утяжеление» ресурса из-за работы поисковых роботов с дублями

Веб-мастер может получить от хостера запрос на то, что нагрузка на сервис из-за сайта увеличилась, придется переходить на тариф подороже. Если выяснится, что больше всего запросов идет от Гугл и Яндекс, то возможной причиной ситуации может быть слишком много дублей. Решить проблему легко – убрать лишние страницы. Тогда не придется доплачивать за хостинг.

Как можно заметить, существует много проблем, которые связаны с клонами. Важно вовремя заметить ошибку, оперативно ее исправить. Рассмотрим подробнее, как поисковые системы оценивают дубли.

Явные дубли страниц на сайте

Таких вариантов существует великое множество, но суть проблемы остается одинаковой. Рассмотрим самые распространенные ошибки.

URL со слешем в конце и без него

Пример:

Что делать: настроить ответ сервера «HTTP 301 Moved Permanently» (301-редирект).

Как убрать дубли страниц на сайте:

-

Найдите в корневой папке сайта файл с названием «.htaccess», откройте. Если нет, то создайте документ в TXT, дайте ему название .htaccess и поместите в корень сайта.

-

Пропишите в файле команды для редиректа с URL со слешем на URL без него:

-

RewriteCond %{REQUEST_FILENAME} !-d

-

RewriteCond %{REQUEST_URI} ^(.+)/$

-

RewriteRule ^(.+)/$ /$1 [R=301,L]

-

-

Обратная операция:

-

RewriteCond %{REQUEST_FILENAME} !-f

-

RewriteCond %{REQUEST_URI} !(.*)/$

-

RewriteRule ^(.*[^/])$ $1/ [L,R=301]

-

-

Когда файл будет создан с нуля, то редиректы нужно прописывать внутри таких строк:

-

<IfModule mod_rewrite.c>

-

...

-

</IfModule>

-

Стоит помнить, что только сайты на Apache можно настраивать с помощью .htaccess, когда речь идет о 301-редиректе. Другой способ придется выбрать для сайтов nginx.

Нужен ли слеш для URL? Разницы особой нет. Если у вас индексируется много страниц со слешем, то оставляйте вариант с ним, если нет, то не нужно лишний раз их вставлять.

URL с WWW и без

Пример:

Что делать с дублями страниц на сайте? Укажите на главное зеркало ресурса в Яндекс.Вебмастер, настройте 301-редирект и укажите канонические URL.

Как указать главное зеркало в Яндекс:

-

зайдите на Вебмастер, добавьте оба варианта – с www и без;

-

выберите сайт, с которого будете перенаправлять – обычно на URL без www);

-

зайдите в раздел «Индексирование / Переезд сайта», снимите галку возле надписи «Добавить www» и сохраните изменения.

Через пару недель Яндекс соединит два зеркала, начнется индексация, а в поиске будет отображаться адрес без трех «W».

Важно! Раньше обязательным условием было прописывание для главного зеркала директивы Host в файле robots.txt. Некоторые до сих пор по привычке выполняют это действие, однако сегодня в нем нет необходимости. Просто проведите склейку через Вебмастер.

Как соединить зеркала в Google?

Существует два способа. Они помогут перевести внимание поисковика на главное зеркало:

-

Настройте 301-редирект на удобную для вас версию. Проверьте после индексации, каких страниц больше в поисковике и настройте переадресацию на их URL.

-

Гугл рекомендует так настроить канонические страницы: добавьте в код тег <link> с атрибутом rel="canonical" или включайте в ответ страниц HTTP-заголовок rel=canonical.

Адреса с HTTP и HTTPS

Сайты с SSL-сертификатами лучше показываются в выдаче. Если не устранить ошибки при переходе на HTTPS, то возникают дубли типа:

Что делать:

-

Оцените, правильно ли вы соединили зеркала в Яндекс, это действие точно, как при склейке «www», но в главном нужно поставить галку напротив «Добавить HTTPS».

-

Проверьте настройки редиректов. Бывает, что в код закрались ошибки. Используйте пошаговую инструкцию настройки, где прописаны все команды для редиректов при HTTPS.

Обратите внимание! Если вы произвели все настройки менее двух недель назад, они еще не вступили в силу. Поисковики начнут индексировать новые адреса через какое-то время.

Адреса с GET-параметрами

После знака «?» в ссылке информацию называют GET-параметрами. Они разделены между собой знаком «&». Каждый новый адрес с GET-параметрами – дубль исходной страницы на сайте.

Пример, исходная страница: http://dom.ru/dog1/gopro

URL с UTM-метками: http://dom.ru/dog1/gopro?utm_source=google&amp;amp;amp;utm_medium=cpc&amp;amp;amp;ut...

URL с идентификатором сессии: http://dom.ru/dog1/gopro?sid=x12k17p83

URL с тегом Google Ads: http://dom.ru/dogt1/gopro?gclid=Kamp1

Что делать:

Вариант 1. Не разрешайте индексировать страницы с GET-параметрами в robots.txt. Для всех роботов существует такая схема запрета:

User-agent: *

Disallow: /*?utm_source=

Disallow: /*&utm_medium=

Disallow: /*&utm_campaign=

Disallow: /*?sid=

Disallow: /*?gclid=

Источник: shutterstock.com

Вариант 2. В Яндекс есть специальная директива для robots.txt под названием Clean-param. Она дает команду алгоритмам не индексировать страницы, в которых есть GET-параметры. Плюс в том, что если не была проиндексирована главная страница, то алгоритм по выбранной директиве сам поймет, что нужно добавить ее в число проверяемых.

Если же использовать для закрытия таких разделов с GET-параметрами директиву Disallow, то роботы просто не будут включать эти адреса в список для исследования. А это исключит из поиска главную страницу.

Минус в том, что Clean-param подходит для Яндекс, а Гугл просто не воспринимает данную директиву, он работает с Disallow по такой схеме:

User-agent: Yandex

Clean-param: utm_source&utm_medium&utm_campaign&sid&gclid

User-agent: Googlebot

Disallow: /*?utm_source=

Disallow: /*&utm_medium=

Disallow: /*&utm_campaign=

Disallow: /*?sid=

Disallow: /*?gclid=

Читайте также!

Один и тот же товар в каталоге, доступный по разным адресам

Пример:

Что делать, чтобы убрать дубли страниц на сайте: настройте атрибут rel="canonical" для тега <link>. Он дает указание, что раздел надежный. Тогда эта страница и будет проиндексирована.

К примеру, вам нужно дать указание алгоритму, что индексируется: http://dom.ru/catalog/sony-mobile. Она является центральной, а другая страница – всего лишь ее копия. В раздел с клонами необходимо добавить такую строчку: <link rel="canonical" href=« http://dom.ru/catalog/sony-mobile&amp;quot;/&amp;gt;

Этот способ позволяет перевести внимание на основную страницу для ее последующей индексации.

Настраивается rel="canonical" средствами PHP, с помощью встроенных функций CMS или плагинов. Так, в Вордпресс есть нужный вам plug-in All in One SEO Pack. Он дает возможность управлять всеми адресами главных страниц самостоятельно.

Версии для печати

Обычно она является дублем исходной страницы, так как текст на них одинаковый.

Пример:

-

Исходная страница: http://dom.ru/article1.html

-

Версия для печати: http://dom.ru/article1.html/?print=1

-

Или такой вариант реализации: http://dom.ru/article1.html/print.php?postid=12

Что делать: запретите роботу индексировать версии для печати, указав это в robots.txt. Отследите, выводятся ли страницы-дубли через GET-параметр ?print. Если да, то используйте для Яндекс директиву Clean-param, а для Google – Disallow:

User-agent: Yandex

Clean-param: print

User-agent: Googlebot

Disallow: /*?print=

Во втором примере просто укажите директиву Disallow для обоих роботов:

User-agent: *

Disallow: /*print.php

Найдите уникальный вариант работы с дублями страниц на сайте

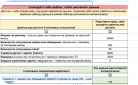

Существует много разных способов закрывать клоны от индексирования. Обычно используется редирект, метатег robots, директива robots.txt или канонизация страниц. У каждой поисковой системы имеются собственные рекомендации.

Источник: shutterstock.com

Яндекс больше любит собственную директиву Clean-param, а также работу через robots.txt. Что касается Гугл, то он не одобряет закрытие дублей через метатег robots и работу с robots.txt. В его арсенале использование rel="canonical" и 301-редирект.

Определите оптимальный способ, который подойдет под ваш сайт. К примеру, его аудиторией являются жители Запада и СНГ, тогда ориентируйтесь на Гугл, в России чаще используется Яндекс.

Не рекомендуется одним махом и всеми рекомендуемыми способами закрывать дубли. Это может привести к путанице и перегрузке. Лучше выбирайте оптимальный вариант, потому что иначе сильно увеличите нагрузку на сервер 301-редиректами.

Мы рассмотрели, как работать с явными дублями страниц на сайте. Но существуют еще иные, когда при разных адресах показывается схожий контент.

Увеличим продажи вашего бизнеса с помощью комплексного продвижения сайта. Наша команда экспертов разработает для вас индивидуальную стратегию, которая позволит в разы увеличить трафик, количество заявок и лидов, снизить стоимость привлечения клиентов и создать стабильный поток новых покупателей.

Неявные дубли страниц на сайте

Дубли древовидных комментариев (replytocom)

Данную проблему обнаруживают на сайтах Вордпресс. Если кто-то пишет что-то в ответ на комментарий к записи, то генерируется новый адрес. Чем больше ветка ответов, тем больше дублей, которые попадают в индекс.

Что делать:

-

Вариант 1. Лучше отключить комментарии в ветках. Для этого перейдите в настройки, найдите параметр «Обсуждение», снимите галочку с «Разрешить древовидные (вложенные) комментарии глубиной N уровней», сохраните изменения. Это сделает работу с комментами не такой удобной, поэтому рассмотрим еще способы.

-

Вариант 2. Отключите штатный модуль комментариев, заменив его на систему Disqus или аналоги: wpDiscuz, Cackle Comments. Пользователи продолжат комментировать, а дублей не останется.

-

Вариант 3. Изменить в коде CMS метод форматирования адреса страниц с ответами на комментарии с replytocom от индексации с помощью метатега robots со значениями "noindex,nofollow". Для этой работы необходимо привлечь специалиста.

Страницы товаров со схожими описаниями

Обычно в интернет-магазине есть широкая группа похожих товаров, где отличаются только размер, цвет, материал. В карточке приходится указывать одинаковую информацию. А поисковая система считывает такие страницы как дубли. Иногда индексируется одна карточка, а вторая остается незамеченной.

Что делать:

-

Вариант 1. Объедините похожие продукты в одной карточке с добавлением селектора, где будет указано на другие параметры. Это упрощает пользовательский опыт и убирает дубли.

-

Вариант 2. Если не смогли добавить селекторы, пишите уникальные аннотации для каждого товара. Возьмите самые популярные, создайте новые тексты, затем заполните другие похожие карточки. Тогда их перестанут засчитывать за дублирующие.

-

Вариант 3. Иногда в карточке нужно перечислить базовые параметры, которые нельзя уникализировать. Эту информацию можно скрыть от роботов с помощью такого тега: <!--noindex-->здесь повторяющийся текст<!--/noindex-->

Различающиеся параметры не нужно скрывать, тогда поисковики засчитают страницы с разными товарами за уникальные. Конечно, данный способ можно назвать временным. И тег noindex считывает только Яндекс. Рекомендуется обратиться к первым двум способам, чтобы убрать дубли страниц на сайте.

Разделы пагинации

На вашем сайте есть каталог, разбитый на разные страницы. Такой метод разбивки называют пагинацией.

Когда вы оптимизируете страницы, нужно учитывать такие нюансы:

-

Если в каталоге размещены SEO-тексты на категориях товаров, то их нужно показывать только на первой странице. Иначе материал будет дублироваться.

-

Не нужно вставлять на страницы пагинации уникальный контент. Это никак не повлияет на индексацию. Проблема не в уникальности текста, а в том, что пользователь не должен попадать из поиска на 10-ю или 20-ю страницу в каталоге. Он хочет видеть все с начала, а затем выбирать, куда идти дальше.

Мы объяснили, как работать с основными типами дублей. Повторимся: их существует великое множество. Главное – понимать принцип их образования, как решать проблему и с помощью каких методов выявлять ошибки.

Работа с дублями страниц пагинации на сайте

Пагинация на ресурсе позволяет разделять большие объемы информации и показывать их на отдельных страницах. Это помогает сайту быстрее грузиться. Еще это улучшает пользовательский опыт, особенно тем, кто смотрит на ресурс с экрана монитора.

Источник: shutterstock.com

Адреса страниц пагинации могут быть как статическими, так и динамическими:

-

Статический: https://dom.ru/catalog/page-2/

-

Динамический адрес: https://dom.ru/catalog?page=2

Однотипные страницы на сайте поисковики часто считывают в качестве дублей, поэтому важно предпринять такие действия:

Запретить индексацию в файле robots.txt

Пропишите Disallow на всех страницах пагинации, кроме первой. Конечно, поисковикам будет сложно найти все товары или новые категории.

Запрет на индексацию в метатеге robots

На всех похожих страницах, кроме основной, пропишите такую инструкцию: <meta name=«robots» content=«noindex, follow» />. Минус у метода – как и у того, что выше.

Назначьте первую страницу в качестве канонической

В других тогда важно прописать rel=«canonical» со ссылкой на нее.

Первая страница – это всегда начальная в категории. Поэтому https://dom.ru/catalog/ и https://dom.ru/catalog/page-1/ будут одной и той же, то есть дубликатами.

Обязательно настройте 301-редирект с https://dom.ru/catalog/page-1/ на https://dom.ru/catalog/.

Создание страницы «Показать все» со всеми товарами всех разделов пагинации

Под эти настройки подгоняются ссылки-канониклы со страниц пагинации. Робот видит только один адрес, а индексируется весь подогнанный контент. Правда, используется метод только для небольших каталогов на 3-4 страницы, иначе загрузка сайта будет очень долгой.

Указание всех страниц пагинации в качестве канонических

Необходимо проставить атрибут для каждой страницы на саму себя с помощью rel=«canonical». Способ позволяет увеличить число коммерческих материалов при индексировании. Он показывает поисковой системе весь каталог, что улучшает коммерческую привлекательность. Обычно его задействуют в иностранном СЕО.

Придание уникальности каждой странице пагинации

Важно проставить на любой раздел номер, топоним или краткую характеристику. Для этого стоит поработать с Title. Важно, чтобы страницы пагинации отличались от основной. А затем их нужно отредактировать по шаблону:

-

Название категории + {номер страницы}

-

Купить {название товара} + в {название города} + по стоимости от {минимальная цена}

-

{Описание товара (тип, цвет и т. д.)} + купить в интернет-магазине «название»

Источник: shutterstock.com

Description страниц пагинации образуется по похожему методу:

-

Заказать {название товара} + в интернет-магазине «название». Скидка 5 % на первый заказ, курьерская бесплатная доставка.

-

Купить {название товара} – доставка по России, гарантия 2 года, наложенный платеж. Более 500 моделей в интернет-магазине «название». Выбирайте {название категории} от производителя.

-

{Название товара} + по стоимости от {минимальная цена} – описание, фото, реальные отзывы. Заходите на сайт «название» или звоните +7 (xxx) xxx-xx-xx.

Текст, который будет оптимизирован, следует разместить только на первой странице каталога. На остальных его повторять нельзя.

Соединение разделов пагинации с помощью атрибутов rel=«prev»/»next»

Если работаете с первой страницей, то в head нужно вставить строку: <link rel=«next» href=«https://dom.ru/page2.html»&amp;gt;. Для каждой следующей нужно указать ссылку на предыдущую и впереди стоящую. Для второй страницы нужно в разделе head прописать:

<link rel=«prev» href=«https://dom.ru/page1.html»&amp;gt;

<link rel=«next» href=«https://dom.ru/page3.html»&amp;gt;

Продолжайте в том же духе. Обратите внимание, что это уже не действует для Яндекс и Гугл. На поиске наличие или отсутствие такой цепочки никак не скажется.

Бесконечная прокрутка или Single Page Content

Как только посетитель сайта скроллит страницу до низа и нажимает «Показать еще», то содержимое категории динамически подгружается. Такие бесконечные ленты актуальны для соцсетей, сайтов с новостями или мобильных версий маркетплейсов. Данный метод заставляет пользователя проводить много времени на сайте.

Чтобы настроить прокрутку, важно задействовать AJAX-подгрузки в JavaScript. Адрес ссылки менять нельзя, по запросу пользователя идет загрузка новой порции информации. Гугл хорошо относится к такому виду показа контента и лучше индексирует ресурс с ним.

Игнорировать работу с пагинацией

Такой метод может показаться недальновидным. Однако ситуация вполне адекватная, так как современные поисковики прекрасно разбираются в структурах сайтов, какой бы способ пагинации не был выбран. Главная задача специалиста – сделать так, чтобы эти разделы индексировались.

Нет какого-то подходящего для всех случаев способа избавиться от неиндексированных дублей страниц на сайте. Важно ориентироваться на ситуацию, смотреть на объем продукции, тип веб-ресурсов, CMS, особенности поисковой системы.

Эксперты, которые занимаются СЕО-продвижением, мечтают сделать опыт идеальным, но ориентироваться нужно на конкретные обстоятельства. Не факт, что один метод сработает дважды на разных ресурсах.

Несмотря на это, существуют тренды в СЕО-среде, которые актуальны для страниц пагинации:

-

не прятать контент от алгоритмов поисковиков;

-

настраивать канониклы на самих на себя;

-

делать страницы пагинации уникальными;

-

настраивать канониклы на страницу View all;

-

пользоваться методом бесконечной прокрутки.

Почему последний пункт актуален? Сегодня около 80 % сайтов просматривают с помощью мобильных устройств. А на маленьком экране пользовательский опыт не связан с пагинацией.

Источник: shutterstock.com

На смартфонах:

-

вертикальная прокрутка;

-

горизонтальное смахивание;

-

просмотр карточек, которых много, с помощью фильтров и сортировок;

-

после клика загружать не только картинку с карточкой или видео, но и материал о товаре, статью или кликать по описаниям – открывать не только одноэкранное изображение или вертикальное видео, но и пространный материал или красочный промоблок с информацией о товаре.

Многостраничный контент на смартфоне просматривают способами, отличными от тех, что диктует традиционная пагинация. Как работать с дублями страниц на сайтах применительно к этой ситуации, следует рассуждать в рамках отдельной статьи.

Существуют определенные технологии. Это отложенная загрузка картинок Lazy Load, стандарты связи LTE и 5G, распределенные сети доставки контента CDN и многие другие способы, которые ускоряют загрузку даже самых тяжелых сайтов. Это позволяет не пользоваться пагинацией, которая нужна для быстрого открытия контента.

Читайте также!

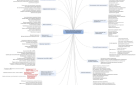

Способы обнаружить дубли страниц на сайте

Существует несколько технологий проверки ресурса на дубли страниц. Все их можно использовать в различных комбинациях, чтобы эффективно выявлять ошибки:

Через операторов

Существуют поисковые маркеры, которые ищут дубли, но делают это довольно медленно. Обычно нужны, чтобы точечно бить в цель – при проведении аудита, когда нет доступа к личному кабинету в Вебмастере или к аналитическим сервисам.

При поиске несмысловых дублей, можно ввести такие команды:

-

site:*хост* «предложение для проверки». В «предложение для проверки» надо вставить любой текст со страницы, на которой будут искать дубли.

Смысловые клоны находят по похожей схеме:

-

site:*хост* «продвигаемая фраза». Будут выданы результаты по убыванию важности поисковых запросов. Вы сами определяете, являются ли эти данные дубликатами или просто содержат похожую информацию. Обратите внимание на раздел «Объединение смысловых дублей», где прописана технология.

Есть специальные операторы, которые ищут вхождение фразы только в тайтлах:

-

в Гугл: allintitle:«фраза» site:*хост*

-

в Яндекс: title:«фраза» site:*хост*

Чтобы найти дубли через адреса, задействуйте такую фразу:

-

site:*хост* inurl:*параметр*

Поисковик покажет только те страницы, которые уже индексировались. Поэтому на этот метод полностью полагаться не стоит.

Личный кабинет Яндекс.Вебмастера

Когда вы имеете возможность зайти в личный кабинет, то нужно проанализировать отчеты на предмет дублирующего контента. Помните, что данные туда прогружаются не очень оперативно.

Порядок, как посмотреть информацию о дублях:

-

Во вкладке «Индексирование» нужно открыть раздел «Страницы в поиске».

-

Зайти в «Исключенные страницы».

-

Отфильтровать данные по статусу «дубль».

В Яндекс есть раздел «Заголовки и описания», там можно посмотреть на страницы с одинаковыми метаописаниями и тегами с названиями.

Google Search Console

Чтобы увидеть страницы с дублями в Гугл, нужно зайти в отчеты и посмотреть исключенные страницы:

-

Если на ней есть тег canonical.

-

Если страница является копией. Канонический вариант не выбран пользователем.

-

Страница является копией. Исходные ее версии, выбранные Google и пользователем, не совпадают.

-

Страница является копией, если отправленный URL не выбран в качестве канонического.

Софт

Выделяют четыре проверенных программы, способных провести проверку страниц на дубли на сайтах онлайн. Разберем три общедоступных и один платный софт.

-

Screaming Frog Seo Spider.

Данная программа может на бесплатной основе проанализировать до пятисот ссылок. На большом сайте придется докупать возможности или использовать другой сервис. Определяет программа дубли по тегам и по тексту.

В ней удобно представлено строение похожих страниц. Показываются даже проценты, можно открыть предпросмотр, нужный текст будет выделен, для самостоятельного изучения обособляются определенные участки контента.

Источник: shutterstock.com

-

SiteAnalyzer.

Бесплатный аналог предыдущей программы, в котором нет визуальных элементов для сравнения, но можно выбрать область для анализа текста.

-

BatchUniqueChecker.

Программа имеет узкую специализацию и проверяет всю массу контента, правда, без метатегов. Сравнивает текстовую составляющую двух страниц.

-

Xenu Link Sleuth.

Позволяет проверить дубли на сайте с помощью метаописаний и тайтлов. Для этого нужно запустить полное сканирование ресурса, затем отсортировать данные по рубрикам «Title» и «Description». Сложность метода заключается в том, что дубли могут иметь разные теги, поэтому с помощью сканирования проблемные страницы выявить не получится.

Источник изображения в шапке: shutterstock.com

Часто задаваемые вопросы о дублях страниц на сайте

Каким образом возникают дубли страниц на сайте?

Выделяют частичные и полные клоны. Обычно они появляются из-за особенностей в работе CMS. Фактически дублирующие страницы могут генерироваться автоматом, если в адресе будут указаны GET-параметры и метки. Некорректные действия человека также приводят к тому, что появляются одинаковые ресурсы, к примеру: специалист, наполняющий сайт, поместил одну и ту же карточку товара в несколько категорий, поэтому теперь информации будут присвоены разные URL-адреса; была допущена ошибка в директивах robots.txt, или на странице 404, а также в настройке 301-редиректов; специалист поработал со структурой сайта, присвоив новые адреса, однако информация на них уже размещена по старым URL. Выделяют смысловые дубли, когда на разные страницы попадают по одним и тем же поисковым запросам. Это происходит из-за неправильного распределения семантики.

Какие будут последствия, если ничего не делать с дублями на сайте?

Сегодня клоны удаляются поисковиками автоматически, по крайней мере, об этом заявляют владельцы Яндекс и Гугл. Однако на деле ситуация не выглядит идеальной. Часто в поисковых системах попадаются страницы с похожим/одинаковым контентом. Поэтому стоит самостоятельно мониторить данные и устранять ошибки.

Как обновление карты сайта позволяет избавиться от дублей?

Существует служебный файл, который называется sitemap.xml. Это и есть карта сайта. В ней находится по порядку выстроенный перечень страниц, которые рекомендованы к выдаче первыми. При каждой проверке алгоритмы смотрят, какие изменения были внесены в файл. Соответственно, они быстро обновляют данные о сайте при выдаче. Стоит помнить, что в этот файл нужно добавлять только открытые для индексации страницы, основные и канонические, которые дают код ответа 200. Следите, чтобы туда не попадали дубли. Все адреса на сайте должны быть доступны в robots.txt для проверки, в них не может содержаться метатег noindex. Карта сайта автоматически обновляется, если регулярно вносить изменения, добавлять, удалять, открывать и закрывать от индексации выбранные страницы. Она является своеобразным советчиком для роботов-поисковиков, говоря, какие разделы владелец ресурса считает самыми качественными. Фактически карта сообщает, что нужно продвигать. Убрать все дубли не всегда получается, особенно если их появление объясняется параметрами страницы. Но чтобы рейтинг в поисковиках не падал, нужно удалять их из индексации. Методы, о которых мы говорили выше, обычно помогают справиться с проблемой. Выберите наиболее подходящий способ, опирайтесь на свои знания, на особенности ресурса, убедитесь в том, что поисковики хорошо воспринимают сайт и считают его качественным.